El Lenguaje de Programación Rust

por Steve Klabnik, Carol Nichols y Chris Krycho, con contribuciones de la Comunidad Rust

Esta versión del texto asume que estás usando Rust 1.82.0 (lanzado 2024-10-17) o posterior. Vea la sección “Instalación” del Capítulo 1 para instalar o actualizar Rust.

El formato HTML está disponible en línea en

https://doc.rust-lang.org/stable/book/

y offline con instalaciones de Rust realizadas con rustup; ejecute rustup doc --book para abrir.

También están disponibles varias traducciones de la comunidad.

Este texto está disponible en formato de libro impreso y ebook de No Starch Press.

🚨 ¿Quieres una experiencia de aprendizaje más interactiva? Prueba una versión diferente del Libro de Rust, con: cuestionarios, resaltado, visualizaciones y más: https://rust-book.cs.brown.edu (en inglés)

Prefacio

No siempre fue tan claro, pero el lenguaje de programación Rust es fundamentalmente sobre empoderamiento: no importa qué tipo de código estás escribiendo ahora, Rust te empodera para llegar más lejos, para programar con confianza en una mayor variedad de dominios de lo que lo hiciste antes.

Tomemos, por ejemplo, el trabajo de “sistemas” que se ocupa de los detalles de bajo nivel de la administración de la memoria, la representación de datos y la concurrencia. Tradicionalmente, este reino de la programación se ve como arcano, accesible sólo a unos pocos que han dedicado los años necesarios para aprender a evitar sus infames trampas. Y aunque aquellos que lo practican lo hacen con precaución, para que su código no esté abierto a vulnerabilidades que puedan ser explotadas, caídas o corrupción.

Rust rompe estas barreras al eliminar las antiguas trampas y proporciona un conjunto amigable y pulido de herramientas para ayudarte en el camino. Los programadores que necesitan “sumergirse” en un control de bajo nivel pueden hacerlo con Rust, sin asumir el riesgo habitual de caídas o agujeros de seguridad, y sin tener que aprender los puntos finos de una cadena de herramientas caprichosa. Lo mejor de todo, el lenguaje está diseñado para guiarte naturalmente hacia un código confiable que es eficiente en términos de velocidad y uso de memoria.

Los programadores que ya están trabajando con código de bajo nivel pueden usar Rust para elevar sus ambiciones. Por ejemplo, introducir la paralelización en Rust es una operación relativamente de bajo riesgo: el compilador lo detectará por ti. Así puedes abordar optimizaciones más agresivas en tu código con la confianza de que no introducirás accidentalmente caídas o vulnerabilidades.

Pero Rust no se limita a la programación de sistemas de bajo nivel. Es lo suficientemente expresivo y ergonómico para hacer que las aplicaciones CLI, servidores web y muchos otros tipos de código sean bastante agradables de escribir - encontrarás ejemplos simples de ambos más adelante en el libro. Trabajar con Rust te permite desarrollar habilidades que se transfieren de un dominio a otro; puedes aprender Rust escribiendo una aplicación web, y luego aplicar esas mismas habilidades para dirigir tu Raspberry Pi.

Este libro abraza plenamente el potencial de Rust para empoderar a tus usuarios. Es un texto amigable y accesible que tiene como objetivo ayudarte a mejorar no sólo tu conocimiento de Rust, sino también tu alcance y confianza como programador en general. Así que sumérgete, prepárate para aprender y ¡bienvenido a la comunidad Rust!

— Nicholas Matsakis y Aaron Turon

Introducción

Nota: Esta edición del libro es la misma que The Rust Programming Language disponible en formato impreso y ebook de No Starch Press.

Bienvenido a El Lenguaje de Programación Rust, un libro introductorio sobre Rust. El lenguaje de programación Rust te ayuda a escribir software más rápido y confiable. La ergonomía de alto nivel y el control de bajo nivel a menudo están en conflicto en el diseño de lenguajes de programación; Rust desafía ese conflicto. A través del equilibrio entre una capacidad técnica poderosa y una gran experiencia de desarrollo, Rust te da la opción de controlar los detalles de bajo nivel (como el uso de memoria) sin todo el problema tradicionalmente asociado con tal control.

Para Quién Es Rust

Rust es ideal para muchas personas por una variedad de razones. Veamos algunos de los grupos más importantes.

Equipos de Desarrolladores

Rust está demostrando ser una herramienta productiva para colaborar entre equipos grandes de desarrolladores con diferentes niveles de conocimiento de programación de sistemas. El código de bajo nivel tiende a tener varios sutiles errores, que en la mayoría de otros lenguajes solo pueden ser detectados a través de pruebas extensivas y una revisión cuidadosa del código por parte de desarrolladores experimentados. En Rust, el compilador juega un rol de guardián al negarse a compilar código con estos errores elusivos, incluidos los errores de concurrencia. Trabajando junto al compilador, el equipo puede dedicar su tiempo a enfocarse en la lógica del programa en lugar de perseguir errores.

Rust también trae herramientas de desarrollo contemporáneas al mundo de la programación de sistemas:

- Cargo, el administrador de dependencias y herramienta de compilación incluido, hace que agregar, compilar y administrar dependencias sea fácil y consistente en todo el ecosistema de Rust.

- La herramienta de formateo Rustfmt garantiza un estilo de codificación consistente entre los desarrolladores.

- El servidor de lenguaje Rust proporciona integración con entornos de desarrollo integrado (IDE) para la finalización del código y los mensajes de error en línea.

Al usar estas y otras herramientas en el ecosistema de Rust, los desarrolladores pueden ser productivos mientras escriben código de nivel de sistemas.

Estudiantes

Rust es para estudiantes y quienes estén interesados en aprender sobre conceptos de sistemas. Usando Rust, muchas personas han aprendido sobre temas como el desarrollo de sistemas operativos. La comunidad es muy acogedora y feliz de responder preguntas de estudiantes. A través de esfuerzos como este libro, los equipos de Rust quieren hacer que los conceptos de sistemas sean más accesibles para más personas, especialmente para quienes son nuevos en la programación.

Empresas

Cientos de empresas, grandes y pequeñas, usan Rust en producción para una variedad de tareas, incluidas herramientas de línea de comandos, servicios web, herramientas de DevOps, dispositivos incrustados, análisis y transcodificación de audio y video, criptomonedas, bioinformática, motores de búsqueda, aplicaciones de Internet de las cosas, aprendizaje automático e incluso partes importantes del navegador web Firefox.

Desarrolladores de Código Abierto

Rust es para personas que quieren construir el lenguaje de programación Rust, la comunidad, las herramientas de desarrollo y las bibliotecas. Nos encantaría que contribuyeras al lenguaje Rust.

Personas que Valoran la Velocidad y la Estabilidad

Rust es para personas que anhelan velocidad y estabilidad en un lenguaje. Por velocidad, nos referimos tanto a la rapidez con que el código Rust puede ejecutarse como a la velocidad con que Rust te permite escribir programas. Las verificaciones del compilador de Rust garantizan la estabilidad a través de adiciones de funcionalidades y refactorizaciones. Esto contrasta con el código heredado quebradizo en lenguajes sin estas verificaciones, que los desarrolladores a menudo tienen miedo de modificar. Al esforzarse por lograr abstracciones de costo cero, características de alto nivel que se compilan en código de bajo nivel tan rápido como el código escrito manualmente, Rust se esfuerza por hacer que el código seguro sea también código rápido.

El lenguaje Rust también espera apoyar a muchos otros usuarios; los mencionados aquí son solo algunos de los principales interesados. En general, la mayor ambición de Rust es eliminar los compromisos que los programadores han aceptado durante décadas al proporcionar seguridad y productividad, velocidad y ergonomía. Pruébalo y ve si sus elecciones funcionan para ti.

Para Quién Es Este Libro

Este libro asume que has escrito código en otro lenguaje de programación, pero no hace ninguna suposición sobre cuál es. Hemos intentado hacer que el material sea ampliamente accesible para aquellos de una amplia variedad de antecedentes en programación. No pasamos mucho tiempo hablando de lo que es la programación o cómo pensar sobre ella. Si eres completamente nuevo en la programación, sería mejor leer un libro que brinde una introducción específica a la programación.

Cómo Usar Este Libro

En general, este libro asume que lo estás leyendo en secuencia, de principio a fin. Los capítulos posteriores se basan en conceptos de los capítulos anteriores, y los capítulos anteriores pueden no profundizar en detalles sobre un tema en particular, pero volverán al tema en un capítulo posterior.

Encontrarás dos tipos de capítulos en este libro: capítulos de conceptos y capítulos de proyectos. En los capítulos de conceptos, aprenderás sobre un aspecto de Rust. En los capítulos de proyectos, construiremos programas pequeños juntos, aplicando lo que has aprendido hasta ahora. Los capítulos 2, 12 y 20 son capítulos de proyectos; el resto son capítulos de conceptos.

El capítulo 1 explica cómo instalar Rust, cómo escribir un programa “Hola, mundo!” Y cómo usar Cargo, el administrador de paquetes y herramienta de compilación de Rust. El capítulo 2 es una introducción práctica a la escritura de un programa en Rust, teniendo que construir un juego de adivinanzas. Aquí tratamos los conceptos a un nivel alto, y capítulos posteriores proporcionarán detalles adicionales. Si quieres ponerte manos a la obra de inmediato, el capítulo 2 es el lugar para eso. El capítulo 3 cubre las características de Rust que son similares a las de otros lenguajes de programación, y en el capítulo 4 aprenderás sobre el sistema de propiedad de Rust. Si eres un aprendiz particularmente meticuloso que prefiere aprender todos los detalles antes de pasar al siguiente, es posible que desees omitir el capítulo 2 y dirigirte directamente al capítulo 3, regresando al capítulo 2 cuando gustes trabajar en un proyecto aplicando los detalles que has aprendido.

El capítulo 5 discute las estructuras y los métodos, y el capítulo 6 cubre las

enumeraciones, las expresiones match, y la construcción de flujo de control

if let. Usarás estructuras y enumeraciones para crear tipos personalizados en

Rust.

En el capítulo 7, aprenderás sobre el sistema de módulos de Rust y sobre las reglas de privacidad para organizar tu código y su interfaz de programación de aplicaciones (API) pública. El capítulo 8 discute algunas estructuras de datos de colección comunes que proporciona la biblioteca estándar, como vectores, cadenas y mapas hash. El capítulo 9 explora la filosofía y técnicas de manejo de errores de Rust.

El capítulo 10 se adentra en los genéricos, los traits y los lifetimes, que te

dan el poder de definir código que se aplique a varios tipos. El capítulo 11 trata

sobre las pruebas, que incluso con las garantías de seguridad de Rust, son

necesarias para asegurar que la lógica de tu programa sea correcta. En el capítulo

12, construiremos nuestra propia implementación de un subconjunto de la

funcionalidad del comando de línea de comandos grep que busca texto dentro de

archivos. Para esto, usaremos muchos de los conceptos que discutimos en los

capítulos anteriores.

El capítulo 13 explora las closures y los iteradores: características de Rust que provienen de los lenguajes de programación funcional. En el capítulo 14, examinaremos Cargo en más profundidad y hablaremos sobre las mejores prácticas para compartir tus bibliotecas con otros. El capítulo 15 discute los punteros inteligentes que proporciona la biblioteca estándar y las características que habilitan su funcionalidad.

En el capítulo 16, recorreremos diferentes modelos de programación concurrente y hablaremos sobre cómo Rust te ayuda a programar en múltiples hilos sin temor. En el capítulo 17 nos basaremos en eso, explorando la sintaxis async y await de Rust y el modelo de concurrencia ligero que admiten.

El capítulo 18 examina cómo los modismos de Rust se comparan con los principios de programación orientada a objetos con los que podrías estar familiarizado.

El capítulo 19 es una referencia a los patrones y el emparejamiento de patrones, que son formas poderosas de expresar ideas en todo programa de Rust. El capítulo 20 contiene un banquete de temas avanzados de interés, incluyendo Rust inseguro, macros y más sobre lifetimes, traits, tipos, funciones y closures.

En el capítulo 21, ¡completaremos un proyecto en el que implementaremos un servidor web de múltiples hilos de bajo nivel!

Finalmente, algunos apéndices contienen información útil sobre el lenguaje en un formato más de referencia. El apéndice A cubre las palabras clave de Rust, el apéndice B cubre los operadores y símbolos de Rust, el apéndice C cubre los traits derivables proporcionados por la biblioteca estándar, el apéndice D cubre algunas herramientas de desarrollo útiles, y el apéndice E explica las ediciones de Rust. En el apéndice F, puede encontrar traducciones del libro, y en el apéndice G cubriremos cómo se hace Rust y qué es Rust nightly.

No hay una forma incorrecta de leer este libro: ¡si quieres adelantarte, hazlo! Es posible que debas volver a los capítulos anteriores si experimentas alguna confusión. Pero haz lo que funcione para ti.

Una parte importante del proceso de aprendizaje de Rust es aprender a leer los mensajes de error que muestra el compilador: estos te guiarán hacia el código funcional. Por lo tanto, proporcionaremos muchos ejemplos que no se compilan junto con el mensaje de error que mostrará el compilador en cada situación. Ten en cuenta que si ingresas y ejecutas un ejemplo aleatorio, ¡es posible que no se compile! Asegúrate de leer el texto circundante para ver si el ejemplo que estás intentando ejecutar está destinado a error. Ferris también te ayudará a distinguir el código que no está destinado a funcionar:

| Ferris | Significado |

|---|---|

| ¡Este código no compila! | |

| ¡Este código provoca un pánico! | |

| Este código no produce el comportamiento deseado. |

En la mayoría de las situaciones, te guiaremos a la versión correcta de cualquier código que no se compile.

Código fuente

Los archivos de origen de los que se genera este libro se pueden encontrar en GitHub.

Empezando

¡Empecemos tu viaje con Rust! Hay mucho que aprender, pero todo viaje comienza en algún lugar. En este capítulo, discutiremos:

- Instalación de Rust en Linux, macOS y Windows

- Escribir un programa que imprima

Hola, mundo! - Uso de

cargo, el administrador de paquetes y sistema de compilación de Rust

Instalación

El primer paso es instalar Rust. Descargaremos Rust a través de rustup, una

herramienta de línea de comandos para administrar las versiones de Rust y las

herramientas asociadas. Necesitarás una conexión a Internet para la descarga.

Nota: Si prefieres no usar

rustuppor alguna razón, consulta la página Otros métodos de instalación de Rust para obtener más opciones.

Los siguientes pasos instalan la última versión estable del compilador de Rust. Las garantías de estabilidad de Rust aseguran que todos los ejemplos del libro que se compilan seguirán compilando con versiones más nuevas de Rust. La salida puede diferir ligeramente entre versiones porque Rust a menudo mejora los mensajes de error y las advertencias. En otras palabras, cualquier versión más nueva, estable de Rust que instales usando estos pasos debería funcionar como se espera con el contenido de este libro.

Notación de línea de comandos

En este capítulo y en todo el libro, mostraremos algunos comandos utilizados en la terminal. Las líneas que debes ingresar en una terminal comienzan con

$. No necesitas escribir el carácter$; es el indicador de línea de comandos mostrado para indicar el comienzo de cada comando. Las líneas que no comienzan con$generalmente muestran la salida del comando anterior. Además, los ejemplos específicos de PowerShell usarán>en lugar de$.

Instalación de rustup en Linux o macOS

Si estás utilizando Linux o macOS, abre una terminal y escribe lo siguiente

$ curl --proto '=https' --tlsv1.2 https://sh.rustup.rs -sSf | sh

El comando descarga un script y comienza la instalación de la herramienta

rustup, que instala la última versión estable de Rust. Es posible que se te

solicite tu contraseña. Si la instalación es exitosa, aparecerá la siguiente

línea:

Rust is installed now. Great!

También necesitarás un enlazador, que es un programa que Rust utiliza para unir sus salidas compiladas en un solo archivo. Es probable que ya lo tengas. Si obtienes errores de enlace, debes instalar un compilador C, que generalmente incluye un enlazador. Un compilador C también es útil porque algunos paquetes comunes de Rust dependen de código C y necesitarán un compilador C.

En macOS, puedes obtener un compilador C ejecutando:

$ xcode-select --install

Los usuarios de Linux deben instalar generalmente GCC o Clang, según la

documentación de su distribución. Por ejemplo, si usas Ubuntu, puede instalar el

paquete build-essential.

Instalación de rustup en Windows

En Windows, ve a https://www.rust-lang.org/tools/install y sigue las instrucciones para instalar Rust. En algún momento de la instalación, recibirás un mensaje para instalar Visual Studio. Este provee un linker y las bibliotecas nativas necesarias para compilar programas.

Para obtener las herramientas de compilación, deberás instalar Visual Studio. Cuando se te pregunte qué paquetes de trabajo instalar, incluye:

- “Desarrollo de escritorio con C ++”

- El SDK de Windows 10 o 11

- El componente de paquete de idioma inglés, junto con cualquier otro paquete de idioma de tu elección

El resto de este libro usa comandos que funcionan tanto en cmd.exe como en PowerShell. Si hay diferencias específicas, explicaremos cuál usar.

Si tu necesitas más ayuda con este paso, mira MSVC prerequisites o escríbenos en nuestro discord

Solución de problemas

Para verificar si has instalado Rust correctamente, abra una shell y escribe esta línea:

$ rustc --version

Deberías ver el número de versión, el hash de confirmación y la fecha de confirmación de la última versión estable que se ha publicado, en el siguiente formato:

rustc x.y.z (abcabcabc yyyy-mm-dd)

Si ves esta información, ¡has instalado Rust correctamente! Si no ves esta

información, verifica que Rust esté en la variable de sistema %PATH% de la

siguiente manera.

En Windows CMD, usa:

> echo %PATH%

En PowerShell, usa:

> echo $env:Path

En Linux y macOS, usa:

$ echo $PATH

Si todo está correcto y Rust aún no funciona, hay varios lugares donde puedes obtener ayuda. Obten información sobre cómo comunicarte con otros Rustaceans (un apodo tonto que nos llamamos a nosotros mismos) en la página de la comunidad.

Actualización y desinstalación

Una vez que Rust se instala a través de rustup, actualizar a una versión

recién lanzada es fácil. Desde tu shell, ejecuta el siguiente script de

actualización:

$ rustup update

Para desinstalar Rust y rustup, ejecuta el siguiente script de desinstalación

desde tu shell:

$ rustup self uninstall

Documentación local

La instalación de Rust también incluye una copia local de la documentación para

que puedas leerla sin conexión. Ejecuta rustup doc para abrir la documentación

local en tu navegador.

En cualquier momento en que se proporcione un tipo o una función de la biblioteca estándar y no estés seguro de lo que hace o cómo usarlo, usa la documentación de la interfaz de programación de aplicaciones (API) para averiguarlo.

Editores de Texto y Entornos de Desarrollo Integrados

Este libro no asume qué herramientas usas para escribir código en Rust. ¡Casi cualquier editor de texto servirá! Sin embargo, muchos editores de texto y entornos de desarrollo integrados (IDEs) tienen soporte integrado para Rust. Siempre puedes encontrar una lista bastante actualizada de muchos editores e IDEs en la página de herramientas del sitio web de Rust.

¡Hola, mundo!

Ahora que has instalado Rust, es hora de escribir tu primer programa en Rust.

Es tradicional cuando se aprende un nuevo lenguaje escribir un pequeño programa

que imprima el texto ¡Hola, mundo! en la pantalla, ¡así que haremos lo mismo

aquí!

Nota: Este libro asume una familiaridad básica con la línea de comandos. Rust no asume cosas específicas sobre tu editor o herramientas o dónde vive tu código, por lo que si prefieres usar un entorno de desarrollo integrado (IDE) en lugar de la línea de comandos, siéntete libre de usar tu IDE favorito. Muchos IDEs ahora tienen algún grado de soporte para Rust; consulta la documentación del IDE para obtener más detalles. El equipo de Rust se ha centrado en habilitar un gran soporte a IDEs a través de

rust-analyzer. Consulta Apéndice D para obtener más detalles.

Creando un directorio de proyecto

Comenzarás creando un directorio para almacenar tu código Rust. A Rust no le importa dónde vive tu código, pero para los ejercicios y proyectos de este libro, sugerimos que hagas un directorio proyectos en tu directorio de inicio y mantengas todos tus proyectos allí.

Abre una terminal y escribe los siguientes comandos para crear un directorio proyectos y un directorio para el proyecto “¡Hola, mundo!” dentro del directorio proyectos.

Para Linux, macOS y PowerShell en Windows, escribe esto:

$ mkdir ~/proyectos

$ cd ~/proyectos

$ mkdir hola_mundo

$ cd hola_mundo

Para Windows CMD, escribe esto:

> mkdir "%USERPROFILE%\proyectos"

> cd /d "%USERPROFILE%\proyectos"

> mkdir hola_mundo

> cd hola_mundo

Escribir y ejecutar un programa en Rust

A continuación, crea un nuevo archivo de texto y llámalo main.rs. Los archivos Rust siempre terminan con la extensión .rs. Si estás usando más de una palabra en tu nombre de archivo, la convención es usar un guión bajo para separarlos. Por ejemplo, usa hola_mundo.rs en lugar de holamundo.rs.

Ahora abre el archivo main.rs que acabas de crear y escribe el código en el Listado 1-1.

fn main() { println!("¡Hola, mundo!"); }

Guarda el archivo y vuelve a la ventana de la terminal en el directorio ~/proyectos/hola_mundo. En Linux o macOS, escribe los siguientes comandos para compilar y ejecutar el archivo:

$ rustc main.rs

$ ./main

¡Hola, mundo!

En Windows, escribe el comando .\main.exe en lugar de ./main:

> rustc main.rs

> .\main.exe

¡Hola, mundo!

Independientemente de tu sistema operativo, la cadena ¡Hola, mundo! debe

imprimirse en la terminal. Si no ves esta salida, consulta la parte

“Solución de problemas” de la sección de

Instalación para obtener formas de obtener ayuda.

Si ¡Hola, mundo! se imprimió, ¡felicidades! Acabas de escribir oficialmente un

programa en Rust. Eso te convierte en un programador de Rust, ¡bienvenido!

Anatomía de un programa en Rust

Revisemos este programa “¡Hola, mundo!” en detalle. Aquí está la primera parte del rompecabezas:

fn main() { }

Estas líneas definen una función llamada main. La función main es especial:

siempre es el primer código que se ejecuta en cada programa ejecutable de Rust.

Aquí, la primera línea declara una función llamada main que no tiene

parámetros y no devuelve nada. Si hubiera parámetros, irían dentro de los

paréntesis ().

El cuerpo de la función está envuelto en {}. Rust requiere llaves alrededor de

todos los cuerpos de función. Es buena costumbre colocar la llave de apertura en

la misma línea que la declaración de la función, agregando un espacio entre

ambos.

Nota: Si deseas mantener un estilo estándar en todos los proyectos de Rust, puedes usar una herramienta de formateo automático llamada

rustfmtpara formatear tu código en un estilo particular (más sobrerustfmten Apéndice D). El equipo de Rust ha incluido esta herramienta con la distribución estándar de Rust, comorustc, por lo que debería estar instalado en tu computadora.

El cuerpo de la función main contiene el siguiente código:

#![allow(unused)] fn main() { println!("¡Hola, mundo!"); }

Esta línea hace todo el trabajo en este pequeño programa: imprime texto en la pantalla. Hay cuatro detalles importantes que hay que notar aquí.

Primero, el estilo de Rust es indentar con cuatro espacios, no con una tabulación.

Segundo, println! llamamos a una macro de Rust. Si hubiéramos llamado a una

función en su lugar, habríamos ingresado println (sin el !). Discutiremos las

macros de Rust en más detalle en el Capítulo 20. Por ahora, solo necesitas saber

que usar un ! significa que estamos llamando a una macro en lugar de una función

normal y que las macros no siempre siguen las mismas reglas que las funciones.

Tercero, ve la cadena "¡Hola, mundo!". Pasamos esta cadena como argumento a

println!, y la cadena se imprime en la pantalla.

Cuarto, terminamos la línea con un punto y coma (;), lo que indica que esta

expresión ha terminado y la siguiente está lista para comenzar. La mayoría de

las líneas de código de Rust terminan con un punto y coma.

Compilar y ejecutar son pasos separados

Acabas de ejecutar un programa recién creado, así que examinemos cada paso en el proceso.

Antes de ejecutar un programa de Rust, debes compilarlo usando el compilador de

Rust ingresando el comando rustc y pasándole el nombre de tu archivo de

código fuente, así:

$ rustc main.rs

Si tienes un trasfondo en C o C ++, notarás que esto es similar a gcc o

clang. Después de compilar con éxito, Rust genera un ejecutable binario.

En Linux, macOS y PowerShell en Windows, puedes ver el ejecutable ingresando el

comando ls en tu shell:

$ ls

main main.rs

En Linux y macOS, verás dos archivos. Con PowerShell en Windows, verás los mismos tres archivos que verías con CMD. Con CMD en Windows, ingresarías lo siguiente:

> dir /B %= la /B significa que solo mostrara los nombres de los archivos =%

main.exe

main.pdb

main.rs

Esto muestra el archivo de código fuente con la extensión .rs, el archivo ejecutable (main.exe en Windows, pero main en todas las otras plataformas), y, cuando se usa Windows, un archivo que contiene información de depuración con la extensión .pdb. Desde aquí, ejecuta el archivo main o main.exe, así:

$ ./main # o .\main.exe en Windows

Si tu main.rs es tu programa "¡Hola, mundo!", Esta línea imprime ¡Hola, mundo! en tu terminal.

Si estás más familiarizado con un lenguaje dinámico, como Ruby, Python o JavaScript, puede que no estés acostumbrado a compilar y ejecutar un programa como pasos separados. Rust es un lenguaje compilado de antemano, lo que significa que puedes compilar un programa y dar el ejecutable a otra persona, y pueden ejecutarlo incluso sin tener Rust instalado. Si le das a alguien un archivo .rb, .py o .js, necesitan tener una implementación de Ruby, Python o JavaScript instalada (respectivamente). Pero en esos lenguajes, sólo necesitas un comando para compilar y ejecutar tu programa. Todo depende de las concesiones hechas al momento de diseñar un lenguaje.

Solo compilar con rustc está bien para programas simples, pero a medida que

tu proyecto crece, querrás administrar todas las opciones y facilitar el

compartir tu código. A continuación, te presentaremos la herramienta

Cargo, que te ayudará a escribir programas de Rust reales.

¡Hola, Cargo!

Cargo es el sistema de compilación y administrador de paquetes de Rust. La mayoría de los Rustaceans usan esta herramienta para administrar sus proyectos Rust porque Cargo maneja muchas tareas para ti, como compilar tu código, descargar las bibliotecas de las que depende tu código y compilar esas bibliotecas. (Llamamos dependencias a las bibliotecas de las que depende tu código).

Los programas Rust más simples, como el que hemos escrito hasta ahora, no tienen dependencias. Si hubiéramos construido el proyecto “¡Hola, mundo!” con Cargo, sólo usaría la parte de Cargo que maneja la compilación de tu código. A medida que escribas programas Rust más complejos, agregarás dependencias, y si comienzas un proyecto usando Cargo, agregar dependencias será mucho más fácil de hacer.

Debido a que la gran mayoría de los proyectos Rust usan Cargo, el resto de este libro asume que también estás usando Cargo. Cargo viene instalado con Rust si usaste los instaladores oficiales que se discuten en la sección “Installation”. Si instalaste Rust a través de algunos otros medios, verifica si Cargo está instalado ingresando lo siguiente en tu terminal:

$ cargo --version

Si ves un número de versión, ¡lo tienes! Si ves un error, como command not found,

consulta la documentación de tu método de instalación para determinar cómo

instalar Cargo por separado.

Creación de un proyecto con Cargo

Vamos a crear un nuevo proyecto usando Cargo y ver cómo difiere de nuestro proyecto original “¡Hola, mundo!”. Navega de vuelta a tu directorio proyectos (o dondequiera que hayas decidido almacenar tu código). Luego, en cualquier sistema operativo, ejecuta lo siguiente:

$ cargo new hello_cargo

$ cd hello_cargo

El primer comando crea un nuevo directorio y proyecto llamado hello_cargo. Hemos nombrado a nuestro proyecto hello_cargo, y Cargo crea sus archivos en un directorio con el mismo nombre.

Ve al directorio hello_cargo y lista los archivos. Verás que Cargo ha generado dos archivos y un directorio para nosotros: un archivo Cargo.toml y un directorio src con un archivo main.rs dentro.

También ha inicializado un nuevo repositorio Git junto con un archivo

.gitignore. Los archivos Git no se generarán si ejecutas cargo new dentro

de un repositorio Git existente; puedes anular este comportamiento usando

cargo new --vcs=git.

Nota: Git es un sistema de control de versiones común. Puedes cambiar

cargo newpara usar un sistema de control de versiones diferente o ningún sistema de control de versiones usando la bandera--vcs. Ejecutacargo new --helppara ver las opciones disponibles.

Abre Cargo.toml en tu editor de texto de elección. Debería verse similar al código del Listado 1-2.

[package]

name = "hello_cargo"

version = "0.1.0"

edition = "2021"

# See more keys and their definitions at https://doc.rust-lang.org/cargo/reference/manifest.html

[dependencies]

Este archivo está en el formato TOML (Tom’s Obvious, Minimal Language), que es el formato de configuración de Cargo.

La primera línea, [package], es un encabezado de sección que indica que las

siguientes declaraciones están configurando un paquete. A medida que agreguemos

más información a este archivo, agregaremos otras secciones.

Las próximas tres líneas establecen la información de configuración que Cargo

necesita para compilar tu programa: el nombre, la versión y la edición de Rust

que se usará. Hablaremos sobre la entrada edition en Apéndice E

La última línea, [dependencies], es el comienzo de una sección para que

enumere cualquier dependencia de tu proyecto. En Rust, los paquetes de código

se denominan crates. No necesitaremos otros crates para este proyecto, pero

lo haremos en el primer proyecto del Capítulo 2, por lo que usaremos esta

sección de dependencias hasta entonces.

Ahora abre src/main.rs y echa un vistazo:

Nombre de archivo: src/main.rs

fn main() { println!("Hello, world!"); }

¡Cargo ha generado un programa “Hello, world!”/“¡Hola, mundo!” para ti, ¡igual que el que escribimos enl Listado 1-1! Hasta ahora, las diferencias entre nuestro proyecto y el proyecto generado por Cargo son que Cargo colocó el código en el directorio src y tenemos un archivo de configuración Cargo.toml en el directorio superior.

Cargo espera que tus archivos de origen vivan dentro del directorio src. El directorio del proyecto de nivel superior es solo para archivos README, información de licencia, archivos de configuración y cualquier otra cosa que no esté relacionada con tu código. Usar Cargo te ayuda a organizar tus proyectos. Hay un lugar para todo, y todo está en su lugar.

Si comenzaste un proyecto que no usa Cargo, como hicimos con el proyecto

“¡Hola, mundo!”, puedes convertirlo en un proyecto que sí use Cargo. Mueve el

código del proyecto al directorio src y crea un archivo Cargo.toml

adecuado. Una forma sencilla de obtener el archivo Cargo.toml es ejecutar

cargo init, el cual lo creara automaticamente.

Construir y ejecutar un proyecto de Cargo

Ahora veamos qué es diferente cuando construimos y ejecutamos el programa “¡Hola, mundo!” con Cargo. ¡Desde tu directorio hello_cargo, construye tu proyecto ingresando el siguiente comando:

$ cargo build

Compiling hello_cargo v0.1.0 (file:///projects/hello_cargo)

Finished dev [unoptimized + debuginfo] target(s) in 2.85 secs

Este comando crea un archivo ejecutable en target/debug/hello_cargo (o target\debug\hello_cargo.exe en Windows) en lugar de en tu directorio actual. Debido a que la compilación predeterminada es una compilación de depuración, Cargo coloca el binario en un directorio llamado debug. Puedes llamar al ejecutable con este comando:

$ ./target/debug/hello_cargo # o .\target\debug\hello_cargo.exe en Windows

Hello, world!

Si todo va bien, Hello, world! debería imprimirse en la terminal. Ejecutar

cargo build por primera vez también hace que Cargo cree un nuevo archivo en

el nivel superior: Cargo.lock. Este archivo rastrea las versiones exactas de

las dependencias de tu proyecto. Este proyecto no tiene dependencias, por lo

que el archivo es un poco escaso. Nunca necesitarás cambiar este archivo

manualmente; Cargo administra su contenido para ti.

Acabamos de construir un proyecto con cargo build y ejecutarlo con

./target/debug/hello_cargo, pero también podemos usar cargo run para

compilar el código y luego llamar al ejecutable resultante en un solo

comando:

$ cargo run

Finished dev [unoptimized + debuginfo] target(s) in 0.0 secs

Running `target/debug/hello_cargo`

Hello, world!

Usar cargo run es más conveniente que tener que recordar ejecutar cargo build y luego usar la ruta completa al binario, por lo que la mayoría de los

desarrolladores usan cargo run.

Ten en cuenta que esta vez no vimos salida que indicara que Cargo estaba

compilando hello_cargo. Cargo supo que los archivos no habían cambiado, por

lo que no volvió a construir, sino que solo ejecutó el binario. Si hubieras

modificado tu código fuente, Cargo habría reconstruido el proyecto antes de

ejecutarlo, y habrías visto esta salida:

$ cargo run

Compiling hello_cargo v0.1.0 (file:///projects/hello_cargo)

Finished dev [unoptimized + debuginfo] target(s) in 0.33 secs

Running `target/debug/hello_cargo`

Hello, world!

Cargo también proporciona un comando llamado cargo check. Este comando

comprueba rápidamente tu código para asegurarse de que compila, pero no

produce un ejecutable:

$ cargo check

Checking hello_cargo v0.1.0 (file:///projects/hello_cargo)

Finished dev [unoptimized + debuginfo] target(s) in 0.32 secs

¿Por qué no querrías un ejecutable? A menudo, cargo check es mucho más rápido

que cargo build porque omite el paso de producir un ejecutable. Si estás

verificando continuamente tu trabajo mientras escribes el código, usar

cargo check acelerará el proceso de informarte si tu proyecto todavía aún está

compilando. ¡Por lo tanto, muchos Rustaceans ejecutan cargo check

periódicamente mientras escriben su programa para asegurarse de que compila!

Luego ejecutan cargo build cuando están listos para usar el ejecutable.

Resumamos lo que hemos aprendido hasta ahora sobre Cargo:

- Podemos crear un proyecto usando

cargo new. - Podemos construir un proyecto usando

cargo build. - Podemos construir y ejecutar un proyecto en un solo paso usando

cargo run. - Podemos construir un proyecto sin producir un binario para verificar errores

usando

cargo check. - En lugar de guardar el resultado de la compilación en el mismo directorio que nuestro código, Cargo lo almacena en el directorio target/debug.

Una ventaja adicional de usar Cargo es que los comandos son los mismos sin importar en qué sistema operativo estés trabajando. Por lo tanto, en este punto, ya no proporcionaremos instrucciones específicas para Linux y macOS versus Windows.

Construyendo una versión de lanzamiento

Cuando tu proyecto finalmente esté listo para su lanzamiento, puedes usar cargo build --release para compilarlo con optimizaciones. Este comando creará un

ejecutable en target/release en lugar de target/debug. Las optimizaciones

hacen que tu código Rust se ejecute más rápido, pero al activarlos se alarga el

tiempo que tarda tu programa en compilarse. Es por eso que hay dos perfiles

diferentes: uno para el desarrollo, cuando deseas reconstruir rápidamente y

con frecuencia, y otro para construir el programa final que le darás al usuario,

que no se reconstruirá repetidamente y que se ejecutará lo más rápido posible.

Si estás midiendo el tiempo de ejecución de tu código, asegúrate de ejecutar

cargo build --release y realizar la prueba de rendimiento con el ejecutable

en target/release.

Cargo como convención

Con proyectos simples, Cargo no proporciona mucho valor por sobre sólo usar

rustc, pero demostrará su valor a medida que tus programas se vuelvan más

intrincados. Una vez que los programas crecen a múltiples archivos o necesitan

una dependencia, es mucho más fácil dejar que Cargo coordine la construcción.

Aunque el proyecto hello_cargo es simple, ahora usas muchas de las herramientas

reales que usarás en el resto de tu carrera en Rust. De hecho, para trabajar en

cualquier proyecto existente, puedes usar los siguientes comandos para verificar

el código usando Git, cambiar al directorio del proyecto y construir:

$ git clone example.org/someproject

$ cd someproject

$ cargo build

Para obtener más información sobre Cargo, consulta su documentación.

Resumen

¡Ya estás en un gran comienzo en tu viaje de Rust! En este capítulo, has aprendido cómo:

- Instalar la última versión estable de Rust usando

rustup - Actualizar a una versión más reciente de Rust

- Abrir documentación instalada localmente

- Escribir y ejecutar un programa "¡Hola, mundo!" usando

rustcdirectamente - Crear y ejecutar un nuevo proyecto usando las convenciones de Cargo

Es un buen momento para construir un programa más sustancial para acostumbrarse a leer y escribir código Rust. Entonces, en el capítulo 2, construiremos un programa de juego de adivinanzas. Si prefieres comenzar aprendiendo cómo funcionan los conceptos de programación comunes en Rust, consulta el capítulo 3 y luego regresa al capítulo 2.

Programando un juego de adivinanzas

¡Vamos a empezar con Rust trabajando en un proyecto práctico! Este capítulo te

introduce a algunos conceptos comunes de Rust mostrándote cómo usarlos en un

programa real. ¡Aprenderás sobre let, match, métodos, funciones asociadas,

paquetes externos y más! En los capítulos siguientes, exploraremos estos

conceptos en más detalle. En este capítulo, solo practicarás los fundamentos.

Implementaremos un clásico problema de programación para principiantes: un juego de adivinanzas. Así es como funciona: el programa generará un número entero aleatorio entre 1 y 100. Luego le pedirá al jugador que ingrese una adivinanza. Después de ingresar una adivinanza, el programa indicará si la adivinanza es demasiado baja o demasiado alta. Si la adivinanza es correcta, el juego imprimirá un mensaje de felicitación y saldrá.

Configurando un nuevo proyecto

Para configurar un nuevo proyecto, vaya al directorio proyectos que creó en el Capítulo 1 y cree un nuevo proyecto usando Cargo, así:

$ cargo new guessing_game

$ cd guessing_game

El primer comando, cargo new, toma el nombre del proyecto (guessing_game)

como el primer argumento. El segundo comando cambia al directorio del nuevo

proyecto.

Mira el archivo Cargo.toml generado:

Nombre de archivo: Cargo.toml

[package]

name = "guessing_game"

version = "0.1.0"

edition = "2021"

[dependencies]

Como viste en el Capítulo 1, cargo new genera un programa “Hola, mundo!” para

ti. Mira el archivo src/main.rs:

Nombre de archivo: src/main.rs

fn main() { println!("Hello, world!"); }

Ahora compilemos este programa “Hola, mundo!” y ejecutémoslo en el mismo paso

usando el comando cargo run:

$ cargo run

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

Finished `dev` profile [unoptimized + debuginfo] target(s) in 0.20s

Running `target/debug/guessing_game`

Hello, world!

El comando run es útil cuando necesitas iterar rápidamente en un proyecto,

como haremos en este juego, probando rápidamente cada iteración antes de

pasar a la siguiente.

Vuelve a abrir el archivo src/main.rs. Escribirás todo el código en este

Procesando una adivinanza

La primera parte del programa del juego de adivinanzas pedirá al usuario que ingrese un valor, procesará ese valor y verificará que el valor esté en el formato esperado. Para comenzar, permitiremos al jugador ingresar una adivinanza. Ingresa el código de la Lista 2-1 en src/main.rs.

use std::io;

fn main() {

println!("Guess the number!");

println!("Please input your guess.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

println!("You guessed: {}", guess);

}Este código contiene mucha información, así que repasémoslo línea por línea.

Para obtener la entrada del usuario y luego imprimir el resultado como salida,

necesitamos traer la biblioteca de entrada/salida io al alcance. La biblioteca

io viene de la biblioteca estándar, conocida como std:

use std::io;

fn main() {

println!("Guess the number!");

println!("Please input your guess.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

println!("You guessed: {}", guess);

}Por defecto, Rust tiene un conjunto de elementos definidos en la biblioteca estándar que trae al alcance de cada programa. Este conjunto se llama prelude, y puedes ver todo lo que contiene en la documentación de la biblioteca estándar.

Si un tipo que quieres usar no está en el prelude, tienes que traer ese tipo

al alcance explícitamente con una declaración use. Usar la biblioteca std::io

te proporciona una serie de características útiles, incluyendo la capacidad de

aceptar la entrada del usuario.

Como viste en el Capítulo 1, la función main es el punto de entrada al

programa:

use std::io;

fn main() {

println!("Guess the number!");

println!("Please input your guess.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

println!("You guessed: {}", guess);

}La sintaxis fn declara una nueva función; los paréntesis, (), indican que

no hay parámetros; y la llave, {, inicia el cuerpo de la función.

Como también aprendiste en el Capítulo 1, println! es una macro que imprime

una cadena en la pantalla:

use std::io;

fn main() {

println!("Guess the number!");

println!("Please input your guess.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

println!("You guessed: {}", guess);

}Este código está imprimiendo una solicitud que indica qué es el juego y está solicitando la entrada del usuario.

Almacenando valores con variables

A continuación, crearemos una variable para almacenar la entrada del usuario, como esto:

use std::io;

fn main() {

println!("Guess the number!");

println!("Please input your guess.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

println!("You guessed: {}", guess);

}¡Ahora el programa está interesante! Hay mucho que está pasando en esta pequeña

línea. Usamos la declaración let para crear la variable. Aquí hay otro

ejemplo:

let apples = 5;Esta línea crea una nueva variable llamada apples y la enlaza con el valor 5.

En Rust, las variables son inmutables por defecto, lo que significa que una vez

que le damos a la variable un valor, el valor no cambiará. Vamos a discutir

este concepto en detalle en la sección “Variables y Mutabilidad”

del Capítulo 3. Para hacer una variable mutable, agregamos mut antes del

nombre de la variable:

let apples = 5; // immutable

let mut bananas = 5; // mutableNota: La sintaxis

//inicia un comentario que continúa hasta el final de la línea. Rust ignora todo lo que está en los comentarios. Vamos a discutir los comentarios en más detalle en el Capítulo 3.

Regresando al programa del juego de adivinanzas, ahora sabes que let mut guess

introducirá una variable mutable llamada guess. El signo igual (=) le dice

a Rust que queremos enlazar algo a la variable ahora. A la derecha del signo

igual está el valor al que guess está enlazado, que es el resultado de llamar

a String::new, una función que devuelve una nueva instancia de un String.

String es un tipo de cadena proporcionado por la

biblioteca estándar que es una parte de texto codificada en UTF-8 que puede

crecer.

La sintaxis :: en la línea ::new indica que new es una función asociada

del tipo String. Una función asociada es una función que está implementada

en un tipo, en este caso String. Esta función new crea una nueva cadena

vacía. Encontrarás una función new en muchos tipos porque es un nombre

común para una función que crea un nuevo valor de algún tipo.

En total, la línea let mut guess = String::new(); ha creado una variable

mutable que está actualmente enlazada a una nueva instancia vacía de un

String. ¡Uf!

Recibiendo la entrada del usuario

Recuerda que incluimos la funcionalidad de entrada/salida de la biblioteca

estándar con use std::io; en la primera línea del programa. Ahora llamaremos

a la función stdin del módulo io, que nos permitirá manejar la entrada del

usuario:

use std::io;

fn main() {

println!("Guess the number!");

println!("Please input your guess.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

println!("You guessed: {}", guess);

}Si no hubiéramos importado la biblioteca io con use std::io; al comienzo del

programa, aún podríamos usar la función escribiendo esta llamada de función

como std::io::stdin. La función stdin devuelve una instancia de

std::io::Stdin, que es un tipo que representa un

manejador de la entrada estándar para tu terminal.

A continuación, la línea .read_line(&mut guess) llama al método

read_line en el manejador de entrada estándar para

obtener la entrada del usuario. También estamos pasando &mut guess como

argumento a read_line para decirle en qué cadena almacenar la entrada del

usuario. El trabajo completo de read_line es tomar lo que el usuario escribe

en la entrada estándar y agregar eso a una cadena (sin sobrescribir su

contenido), por lo que, por lo tanto, pasamos esa cadena como argumento. La

cadena de argumentos debe ser mutable para que el método pueda cambiar el

contenido de la cadena.

El & indica que este argumento es una referencia, que te da una forma de

permitir que varias partes de tu código accedan a una pieza de datos sin

necesidad de copiar esos datos en la memoria varias veces. Las referencias son

una característica compleja, y una de las principales ventajas de Rust es lo

seguro y fácil que es usar referencias. No necesitas saber mucho de esos

detalles para terminar este programa. Por ahora, todo lo que necesitas saber es

que, como las variables, las referencias son inmutables por defecto. Por lo

tanto, necesitas escribir &mut guess en lugar de &guess para hacerlo

mutable. (El capítulo 4 explicará las referencias con más detalle.)

Manejando el posible fallo con Result

Todavía estamos trabajando en esta línea de código. Ahora estamos discutiendo una tercera línea de texto, pero ten en cuenta que aún es parte de una sola línea lógica de código. La siguiente parte es este método:

use std::io;

fn main() {

println!("Guess the number!");

println!("Please input your guess.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

println!("You guessed: {}", guess);

}Podríamos haber escrito este código como:

io::stdin().read_line(&mut guess).expect("Failed to read line");Sin embargo, una línea larga es difícil de leer, por lo que es mejor dividirla.

A menudo es sabio introducir un salto de línea y otros espacios en blanco para

ayudar a dividir líneas largas cuando llamas a un método con la sintaxis

.method_name(). Ahora discutamos lo que hace esta línea.

Como se mencionó anteriormente, read_line coloca lo que el usuario ingresa en

la cadena que le pasamos, pero también devuelve un valor Result. Result es una enumeración, a menudo

llamada enum, que es un tipo que puede estar en uno de varios estados

posibles. Llamamos a cada estado posible a una variante.

El Capítulo 6 cubrirá las enumeraciones con más

detalles. El propósito de estos tipos Result es codificar información de

manejo de errores.

Las variantes de Result son Ok y Err. La variante Ok indica que la

operación fue exitosa, y dentro de Ok está el valor generado con éxito. La

variante Err significa que la operación falló, y Err contiene información

sobre cómo o por qué la operación falló.

Los valores del tipo Result, como los valores de cualquier tipo, tienen

métodos definidos en ellos. Una instancia de Result tiene un método

expect que puedes llamar. Si esta instancia de

Result es un valor Err, expect hará que el programa se bloquee y muestre

el mensaje que pasaste como argumento a expect. Si el método read_line

devuelve un Err, probablemente sea el resultado de un error proveniente del

sistema operativo subyacente. Si esta instancia de Result es un valor Ok,

expect tomará el valor de retorno que Ok está sosteniendo y devolverá solo

ese valor para que lo puedas usar. En este caso, ese valor es el número de

bytes en la entrada del usuario.

Si no llamas a expect, el programa se compilará, pero obtendrás una advertencia:

$ cargo build

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

warning: unused `Result` that must be used

--> src/main.rs:10:5

|

10 | io::stdin().read_line(&mut guess);

| ^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^^

|

= note: this `Result` may be an `Err` variant, which should be handled

= note: `#[warn(unused_must_use)]` on by default

help: use `let _ = ...` to ignore the resulting value

|

10 | let _ = io::stdin().read_line(&mut guess);

| +++++++

warning: `guessing_game` (bin "guessing_game") generated 1 warning

Finished `dev` profile [unoptimized + debuginfo] target(s) in 0.59s

Rust advierte que no has usado el valor Result devuelto por read_line,

indicando que el programa no ha manejado un posible error.

La forma correcta de suprimir la advertencia es escribir realmente código de

manejo de errores, pero en nuestro caso solo queremos bloquear este programa

cuando ocurra un problema, por lo que podemos usar expect. Aprenderás a

recuperarte de los errores en el Capítulo 9.

Imprimiendo valores con marcadores de posición println!

Además del corchete de cierre, solo hay una línea más que discutir en el código hasta ahora:

use std::io;

fn main() {

println!("Guess the number!");

println!("Please input your guess.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

println!("You guessed: {}", guess);

}Esta línea imprime la cadena que ahora contiene la entrada del usuario. El

conjunto de llaves {} es un marcador de posición: piensa en {} como pequeñas

pinzas de cangrejo que mantienen un valor en su lugar. Al imprimir el valor de

una variable, el nombre de la variable puede ir dentro de las llaves

curvas. Al imprimir el resultado de evaluar una expresión, coloca llaves

curvas vacías en la cadena de formato, luego sigue la cadena de formato con una

lista separada por comas de expresiones para imprimir en cada marcador de

posición vacío de llaves curvas en el mismo orden. Imprimir una variable y el

resultado de una expresión en una llamada a println! se vería así:

#![allow(unused)] fn main() { let x = 5; let y = 10; println!("x = {x} and y + 2 = {}", y + 2); }

Este código imprimiría x = 5 and y + 2 = 12.

Probando la primera parte

Probemos la primera parte del juego de adivinanzas. Ejecútalo usando cargo run:

$ cargo run

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

Finished `dev` profile [unoptimized + debuginfo] target(s) in 6.44s

Running `target/debug/guessing_game`

Guess the number!

Please input your guess.

6

You guessed: 6

En este punto, la primera parte del juego está terminada: estamos obteniendo entrada del teclado y luego la imprimimos.

Generando un número secreto

A continuación, necesitamos generar un número secreto que el usuario intentará

adivinar. El número secreto debe ser diferente cada vez para que el juego sea

divertido de jugar más de una vez. Usaremos un número aleatorio entre 1 y 100

para que el juego no sea demasiado difícil. Rust aún no incluye la

funcionalidad de números aleatorios en su biblioteca estándar. Sin embargo, el

equipo de Rust proporciona un rand crate con dicha

funcionalidad.

Usando un Crate para obtener más funcionalidad

Recuerda que un crate es una colección de archivos de código fuente de Rust. El

proyecto que hemos estado construyendo es un binary crate, que es un

ejecutable. El crate rand es un library crate, que contiene código que se

pretende usar en otros programas y no se puede ejecutar por sí solo.

La coordinación de los crates externos de Cargo es donde realmente brilla

Cargo. Antes de poder escribir código que use rand, necesitamos modificar el

archivo Cargo.toml para incluir el crate rand como una dependencia. Abre ese

archivo ahora y agrega la siguiente línea al final, debajo del encabezado de la

sección [dependencies] que Cargo creó para ti. Asegúrate de especificar rand

exactamente como lo tenemos aquí, con este número de versión, o los ejemplos de

código en este tutorial pueden no funcionar:

Nombre de archivo: Cargo.toml

[dependencies]

rand = "0.8.5"

En el archivo Cargo.toml, todo lo que sigue a un encabezado es parte de esa

sección que continúa hasta que comienza otra sección. En [dependencies] le

dices a Cargo qué crates externos depende tu proyecto y qué versiones de esos

crates requieres. En este caso, especificamos el crate rand con el

especificador de versión semántica 0.8.5. Cargo entiende Semantic

Versioning (a veces llamado SemVer), que es un

estándar para escribir números de versión. El especificador 0.8.5 es

realmente un atajo para ^0.8.5, lo que significa cualquier versión que sea

al menos 0.8.5 pero inferior a 0.9.0.

Cargo considera que estas versiones tienen APIs públicas compatibles con la versión 0.8.5, y esta especificación asegura que obtendrá la última versión de corrección que aún se compilará con el código de este capítulo. Cualquier versión 0.9.0 o superior no está garantizada de tener la misma API que lo que usarán los siguientes ejemplos.

Ahora, sin cambiar ningún código, construyamos el proyecto, como se muestra en el Listado 2-2.

$ cargo build

Updating crates.io index

Locking 16 packages to latest compatible versions

Adding wasi v0.11.0+wasi-snapshot-preview1 (latest: v0.13.3+wasi-0.2.2)

Adding zerocopy v0.7.35 (latest: v0.8.9)

Adding zerocopy-derive v0.7.35 (latest: v0.8.9)

Downloaded syn v2.0.87

Downloaded 1 crate (278.1 KB) in 0.16s

Compiling proc-macro2 v1.0.89

Compiling unicode-ident v1.0.13

Compiling libc v0.2.161

Compiling cfg-if v1.0.0

Compiling byteorder v1.5.0

Compiling getrandom v0.2.15

Compiling rand_core v0.6.4

Compiling quote v1.0.37

Compiling syn v2.0.87

Compiling zerocopy-derive v0.7.35

Compiling zerocopy v0.7.35

Compiling ppv-lite86 v0.2.20

Compiling rand_chacha v0.3.1

Compiling rand v0.8.5

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

Finished `dev` profile [unoptimized + debuginfo] target(s) in 3.69s

Es posible que veas números de versión diferentes (¡pero todos serán compatibles con el código, gracias a SemVer!) y líneas diferentes (dependiendo del sistema operativo), y las líneas pueden estar en un orden diferente.

Cuando incluimos una dependencia externa, Cargo obtiene las últimas versiones de todo lo que la dependencia necesita del registro, que es una copia de datos de Crates.io. Crates.io es donde las personas en el ecosistema de Rust publican sus proyectos de Rust de código abierto para que otros los utilicen.

Después de actualizar el registro, Cargo verifica la sección [dependencies]

y descarga cualquier crate que se haya enumerado que aún no se haya

descargado. En este caso, aunque solo enumeramos rand como una dependencia,

Cargo también tomó otros crates que rand depende para funcionar. Después de

descargar los crates, Rust los compila y luego compila el proyecto con las

dependencias disponibles.

Si ejecuta cargo build nuevamente sin hacer ningún cambio, no obtendrá

ninguna salida aparte de la línea Finished. Cargo sabe que ya ha descargado y

compilado las dependencias, y no ha cambiado nada sobre ellas en su archivo

Cargo.toml. Cargo también sabe que no ha cambiado nada sobre su código, por

lo que tampoco lo vuelve a compilar. Sin nada que hacer, simplemente sale.

Si abre el archivo src/main.rs, realiza un cambio trivial y luego lo guarda y vuelve a construir, solo verá dos líneas de salida:

$ cargo build

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

Finished `dev` profile [unoptimized + debuginfo] target(s) in 0.13s

Estas líneas muestran que Cargo solo actualiza la compilación con su pequeño cambio en el archivo src/main.rs. Sus dependencias no han cambiado, por lo que Cargo sabe que puede reutilizar lo que ya ha descargado y compilado para esas.

Garantizar compilaciones reproducibles con el archivo Cargo.lock

Cargo tiene un mecanismo que le garantiza que puede reconstruir el mismo

artefacto cada vez que usted o cualquier otra persona construye su código:

Cargo solo usará las versiones de las dependencias que haya especificado hasta

que indique lo contrario. Por ejemplo, digamos que la semana que viene sale la

versión 0.8.6 del crate rand, y que esa versión contiene una corrección de

error importante, pero también contiene una regresión que romperá su código.

Para manejar esto, Rust crea el archivo Cargo.lock la primera vez que ejecuta

cargo build, por lo que ahora tenemos esto en el directorio guessing_game

Cuando construye un proyecto por primera vez, Cargo determina todas las versiones de las dependencias que cumplen con los criterios y luego las escribe en el archivo Cargo.lock. Cuando construye su proyecto en el futuro, Cargo verá que el archivo Cargo.lock existe y usará las versiones especificadas allí en lugar de hacer todo el trabajo de averiguar las versiones nuevamente. Esto le permite tener una compilación reproducible de forma automática. En otras palabras, su proyecto permanecerá en 0.8.5 hasta que actualice explícitamente, gracias al archivo Cargo.lock. Debido a que el archivo Cargo.lock es importante para las compilaciones reproducibles, a menudo se verifica en el control de versiones con el resto del código en su proyecto.

Actualizar un crate para obtener una nueva versión

Cuando quiera actualizar un crate, Cargo proporciona el comando update,

que ignorará el archivo Cargo.lock y determinará todas las últimas versiones

que cumplan con sus especificaciones en Cargo.toml. Cargo luego escribirá

esas versiones en el archivo Cargo.lock. En este caso, Cargo solo buscará

versiones mayores que 0.8.5 y menores que 0.9.0. Si el crate rand ha lanzado

las dos nuevas versiones 0.8.6 y 0.9.0, vería lo siguiente si ejecutara

cargo update:

$ cargo update

Updating crates.io index

Updating rand v0.8.5 -> v0.8.6

Cargo ignora el lanzamiento 0.9.0. En este punto, también notaría un cambio en

su archivo Cargo.lock que indica que la versión del crate rand que ahora

está usando es 0.8.6. Para usar la versión 0.9.0 o cualquier versión en la

serie 0.9.x, tendría que actualizar el archivo Cargo.toml para que se

vea así:

[dependencies]

rand = "0.9.0"

La próxima vez que ejecute cargo build, Cargo actualizará el registro de

crates disponibles y volverá a evaluar sus requisitos de rand de acuerdo con

la nueva versión que ha especificado.

Hay mucho más que decir sobre Cargo y su ecosistema, que discutiremos en el Capítulo 14, pero por ahora, eso es todo lo que necesita saber. Cargo hace muy fácil reutilizar bibliotecas, por lo que los Rustaceans pueden escribir proyectos más pequeños que se ensamblan a partir de un número de paquetes.

Generar un numero aleatorio

Comencemos a usar rand para generar un número para adivinar. El siguiente

paso es actualizar src/main.rs, como se muestra en el Listado 2-3.

use std::io;

use rand::Rng;

fn main() {

println!("Guess the number!");

let secret_number = rand::thread_rng().gen_range(1..=100);

println!("The secret number is: {secret_number}");

println!("Please input your guess.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

println!("You guessed: {guess}");

}Primero agregamos la línea use rand::Rng;. El trait Rng define métodos que

los generadores de números aleatorios implementan, y este trait debe estar en

el alcance para que podamos usar esos métodos. El Capítulo 10 cubrirá los

traits en detalle.

A continuación, estamos agregando dos líneas en el medio. En la primera línea,

llamamos a la función rand::thread_rng que nos da el generador de números

aleatorios particular que vamos a usar: uno que es local al hilo de ejecución

actual y está sembrado por el sistema operativo. Luego llamamos al método

gen_range en el generador de números aleatorios. Este método está definido

por el trait Rng que traemos al alcance con la declaración use rand::Rng;.

El método gen_range toma una expresión de rango como argumento y genera un

número aleatorio en el rango. El tipo de expresión de rango que estamos

utilizando aquí toma la forma start..=end y es inclusivo en los límites

inferior y superior, por lo que necesitamos especificar 1..=100 para solicitar

un número entre 1 y 100.

Nota: No sabrá solo qué traits usar y qué métodos y funciones llamar desde un crate, por lo que cada crate tiene documentación con instrucciones para usarlo. Otra característica interesante de Cargo es que ejecutar el comando

cargo doc --openconstruirá la documentación proporcionada por todas sus dependencias localmente y la abrirá en su navegador. Si está interesado en otra funcionalidad en el craterand, por ejemplo, ejecutecargo doc --openy haga clic enranden la barra lateral a la izquierda.

La segunda línea nueva imprime el número secreto. Esto es útil mientras desarrollamos el programa para poder probarlo, pero lo eliminaremos de la versión final. ¡No es mucho un juego si el programa imprime la respuesta tan pronto como comienza!

Intente ejecutar el programa varias veces:

$ cargo run

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

Finished `dev` profile [unoptimized + debuginfo] target(s) in 0.02s

Running `target/debug/guessing_game`

Guess the number!

The secret number is: 7

Please input your guess.

4

You guessed: 4

$ cargo run

Finished `dev` profile [unoptimized + debuginfo] target(s) in 0.02s

Running `target/debug/guessing_game`

Guess the number!

The secret number is: 83

Please input your guess.

5

You guessed: 5

Debería obtener números aleatorios diferentes, y todos deberían ser números entre 1 y 100. ¡Gran trabajo!

Comparando la Adivinanza con el Número Secreto

Ahora que tenemos la entrada del usuario y un número aleatorio, podemos compararlos. Ese paso se muestra en el Listado 2-4. Tenga en cuenta que este código aún no se compilará, como explicaremos.

use rand::Rng;

use std::cmp::Ordering;

use std::io;

fn main() {

// --snip--

println!("Guess the number!");

let secret_number = rand::thread_rng().gen_range(1..=100);

println!("The secret number is: {secret_number}");

println!("Please input your guess.");

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

println!("You guessed: {guess}");

match guess.cmp(&secret_number) {

Ordering::Less => println!("Too small!"),

Ordering::Greater => println!("Too big!"),

Ordering::Equal => println!("You win!"),

}

}Primero agregamos otra declaración use, que trae un tipo llamado

std::cmp::Ordering al alcance de la biblioteca estándar. El tipo Ordering

es otro enum y tiene las variantes Less, Greater y Equal. Estos son los

tres resultados posibles cuando compara dos valores.

Luego agregamos cinco nuevas líneas al final que usan el tipo Ordering. El

método cmp compara dos valores y se puede llamar en cualquier cosa que se

pueda comparar. Toma una referencia a lo que quiera comparar: aquí está

comparando guess con secret_number. Luego devuelve una variante del enum

Ordering que importamos al alcance con la declaración use. Usamos una

expresión match para decidir qué hacer a continuación

basándonos en qué variante de Ordering se devolvió de la llamada a cmp con

los valores en guess y secret_number.

Una expresión match está compuesta por brazos. Un brazo consta de un

patrón para coincidir y el código que se debe ejecutar si el valor dado a

match se ajusta al patrón del brazo. Rust toma el valor dado a match y

busca cada patrón de brazo en orden. Los patrones y la construcción match son

potentes características de Rust: le permiten expresar una variedad de

situaciones que su código puede encontrar y se aseguran de que los maneje

todos. Estas características se cubrirán en detalle en el Capítulo 6 y el

Capítulo 19, respectivamente.

Vamos a repasar un ejemplo con la expresión match que usamos aquí. Digamos

que el usuario ha adivinado 50 y el número secreto generado aleatoriamente

esta vez es 38.

Cuando el código compara 50 con 38, el método cmp devolverá

Ordering::Greater porque 50 es mayor que 38. La expresión match obtiene el

valor Ordering::Greater y comienza a verificar el patrón de cada brazo. Mira

el patrón del primer brazo, Ordering::Less, y ve que el valor

Ordering::Greater no coincide con Ordering::Less, ¡así que ignora el código

en ese brazo y se mueve al siguiente brazo! El patrón del siguiente brazo es

Ordering::Greater, ¡que sí coincide con Ordering::Greater! El código

asociado en ese brazo se ejecutará y mostrará Too big! en la pantalla. La

expresión match termina después de la primera coincidencia exitosa, ¡así que

no mirará el último brazo en este escenario.

Sin embargo, el código del Listado 2-4 aún no se compilará. Vamos a intentarlo:

$ cargo build

Compiling libc v0.2.86

Compiling getrandom v0.2.2

Compiling cfg-if v1.0.0

Compiling ppv-lite86 v0.2.10

Compiling rand_core v0.6.2

Compiling rand_chacha v0.3.0

Compiling rand v0.8.5

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

error[E0308]: mismatched types

--> src/main.rs:22:21

|

22 | match guess.cmp(&secret_number) {

| --- ^^^^^^^^^^^^^^ expected `&String`, found `&{integer}`

| |

| arguments to this method are incorrect

|

= note: expected reference `&String`

found reference `&{integer}`

note: method defined here

--> file:///home/.rustup/toolchains/1.82/lib/rustlib/src/rust/library/core/src/cmp.rs:838:8

|

838 | fn cmp(&self, other: &Self) -> Ordering;

| ^^^

For more information about this error, try `rustc --explain E0308`.

error: could not compile `guessing_game` (bin "guessing_game") due to 1 previous error

El núcleo del error indica que hay tipos no coincidentes. Rust tiene un

sistema de tipos fuerte y estático. Sin embargo, también tiene inferencia de

tipo. Cuando escribimos let mut guess = String::new(), Rust pudo inferir que

guess debería ser un String y no nos obligó a escribir el tipo. El

secret_number, por otro lado, es un tipo de número. Algunos de los tipos de

números de Rust pueden tener un valor entre 1 y 100: i32, un número de 32 bits;

u32, un número sin signo de 32 bits; i64, un número de 64 bits; así como

otros. A menos que se especifique lo contrario, Rust predetermina un i32, que

es el tipo de secret_number a menos que agregue información de tipo en otro

lugar que haga que Rust infiera un tipo numérico diferente. La razón del error

es que Rust no puede comparar una cadena y un tipo numérico.

Finalmente, queremos convertir la String que el programa lee como entrada en

un tipo de número real para que podamos compararlo numéricamente con el número

secreto. Lo hacemos agregando esta línea al cuerpo de la función main:

Nombre de archivo: src/main.rs

use rand::Rng;

use std::cmp::Ordering;

use std::io;

fn main() {

println!("Guess the number!");

let secret_number = rand::thread_rng().gen_range(1..=100);

println!("The secret number is: {secret_number}");

println!("Please input your guess.");

// --snip--

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

let guess: u32 = guess.trim().parse().expect("Please type a number!");

println!("You guessed: {guess}");

match guess.cmp(&secret_number) {

Ordering::Less => println!("Too small!"),

Ordering::Greater => println!("Too big!"),

Ordering::Equal => println!("You win!"),

}

}La línea es:

let guess: u32 = guess.trim().parse().expect("Please type a number!");Creamos una variable llamada guess. Pero espera, ¿no tiene el programa ya una

variable llamada guess? Lo hace, pero Rust nos permite redefinir el valor

anterior de guess con uno nuevo. Este concepto en Rust se le conoce como

Shadowing, nos permite volver a usar el nombre de la variable guess

en lugar de obligarnos a crear dos variables únicas, como guess_str

y guess, por ejemplo. Lo cubriremos con más detalle en el

Capítulo 3, pero por ahora, sé que esta

característica se usa a menudo cuando desea convertir un valor de un tipo a

otro tipo.

Enlazamos esta nueva variable a la expresión guess.trim().parse(). La guess

en la expresión se refiere a la variable guess original que contenía la

entrada como una cadena. El método trim en una instancia String eliminará

cualquier espacio en blanco al principio y al final, lo que debemos hacer para

poder comparar la cadena con el u32, que solo puede contener datos numéricos.

El usuario debe presionar enter para satisfacer read_line e

ingresar su conjetura, lo que agrega un carácter de nueva línea a la cadena. Por

ejemplo, si el usuario escribe 5 y presiona enter, guess

se ve así: 5\n. El \n representa "nueva línea". (En Windows, presionar

enter resulta en un retorno de carro y una nueva línea, \r\n). El

método trim elimina \n o \r\n, lo que resulta en solo 5.

El método parse en las cadenas convierte una cadena

en otro tipo. Aquí, lo usamos para convertir de una cadena a un número. Debemos

decirle a Rust el tipo de número exacto que queremos usando let guess: u32.

Los dos puntos (:) después de guess le dicen a Rust que anotaremos el tipo

de variable. Rust tiene algunos tipos de número integrados; el u32 visto

aquí es un entero sin signo de 32 bits. Es una buena opción predeterminada para

un número positivo pequeño. Aprenderá sobre otros tipos de números en el

Capítulo 3.

Además, la anotación u32 en este programa de ejemplo y la comparación con

secret_number significa que Rust inferirá que secret_number también

debería ser u32. ¡Entonces la comparación será entre dos valores del mismo

tipo!

El método parse solo funcionará en caracteres que se puedan convertir

lógicamente en números y, por lo tanto, pueden causar fácilmente errores. Si,

por ejemplo, la cadena contiene A👍%, no habría manera de convertir eso en un

número. Debido a que podría fallar, el método parse devuelve un tipo Result,

tal como lo hace el método read_line (discutido anteriormente en

“Manejo de posibles fallas con Result”).

Trataremos este Result de la misma manera usando el método expect de nuevo.

Si parse devuelve una variante Err del tipo Result porque no pudo crear

un número a partir de la cadena, la llamada expect hará que el juego se

bloquee y muestre el mensaje que le damos. Si parse puede convertir

exitosamente la cadena en un número, devolverá la variante Ok del tipo

Result, y expect devolverá el número que queremos del valor Ok.

¡Corramos el programa ahora!

$ cargo run

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

Finished `dev` profile [unoptimized + debuginfo] target(s) in 0.26s

Running `target/debug/guessing_game`

Guess the number!

The secret number is: 58

Please input your guess.

76

You guessed: 76

Too big!

¡Bien! Aunque se agregaron espacios antes de la adivinanza, el programa aún sabía que el usuario adivinó 76. Ejecute el programa varias veces para verificar el comportamiento diferente con diferentes tipos de entrada: adivine el número correctamente, adivine un número que sea demasiado alto y adivine un número que sea demasiado bajo.

Tenemos la mayoría del juego funcionando ahora, pero el usuario solo puede adivinar una vez. ¡Cambiamos eso agregando un bucle!

Permitir múltiples adivinanzas con bucles

La palabra clave loop crea un bucle infinito. Agregaremos un bucle para darle

a los usuarios más oportunidades para adivinar el número:

Nombre de archivo: src/main.rs

use rand::Rng;

use std::cmp::Ordering;

use std::io;

fn main() {

println!("Guess the number!");

let secret_number = rand::thread_rng().gen_range(1..=100);

// --snip--

println!("The secret number is: {secret_number}");

loop {

println!("Please input your guess.");

// --snip--

let mut guess = String::new();

io::stdin()

.read_line(&mut guess)

.expect("Failed to read line");

let guess: u32 = guess.trim().parse().expect("Please type a number!");

println!("You guessed: {guess}");

match guess.cmp(&secret_number) {

Ordering::Less => println!("Too small!"),

Ordering::Greater => println!("Too big!"),

Ordering::Equal => println!("You win!"),

}

}

}Como puede ver, hemos movido todo desde la solicitud de entrada de adivinanzas hacia adelante en un bucle. Asegúrese de indentar las líneas dentro del bucle otras cuatro veces y ejecute el programa nuevamente. ¡El programa ahora pedirá otra adivinanza para siempre, lo que introduce un nuevo problema! ¡Parece que el usuario no puede salir!

El usuario siempre podría interrumpir el programa usando el atajo de teclado

ctrl-c. Pero hay otra forma de escapar de este monstruo insaciable,

como se mencionó en la discusión de parse en

“Comparando la adivinanza con el número secreto”: si el usuario ingresa una respuesta que no es un número, el

programa se bloqueará. Podemos aprovechar eso para permitir que el usuario

salga, como se muestra aquí:

$ cargo run

Compiling guessing_game v0.1.0 (file:///projects/guessing_game)

Finished `dev` profile [unoptimized + debuginfo] target(s) in 0.23s

Running `target/debug/guessing_game`

Guess the number!

The secret number is: 59

Please input your guess.

45

You guessed: 45

Too small!

Please input your guess.

60

You guessed: 60

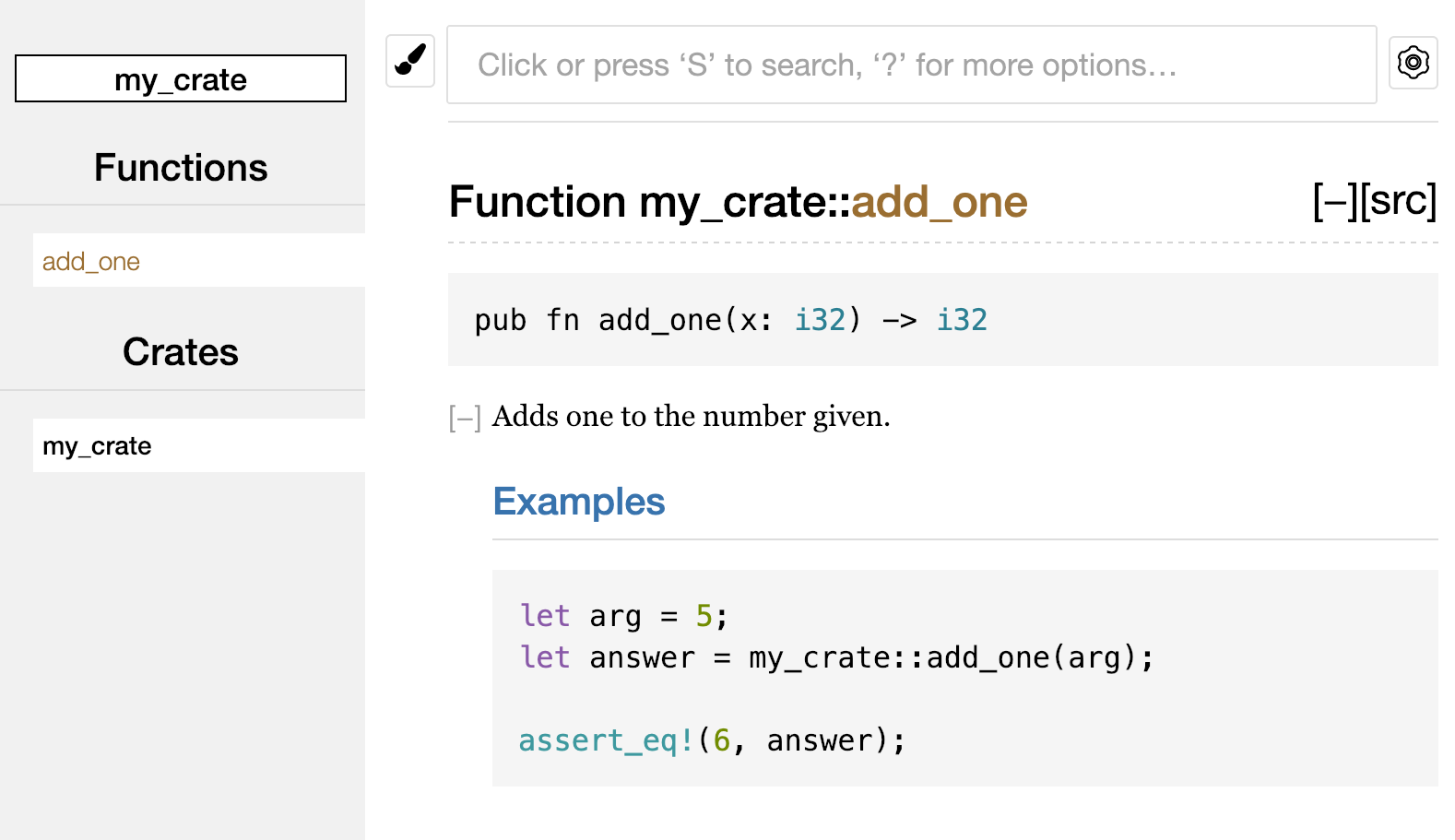

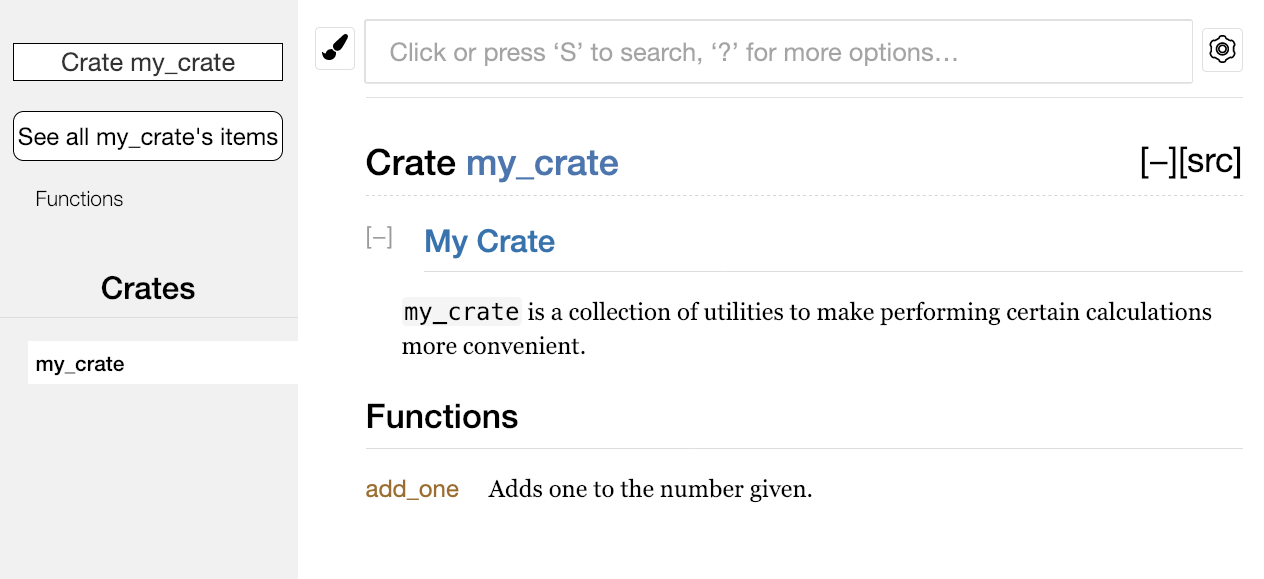

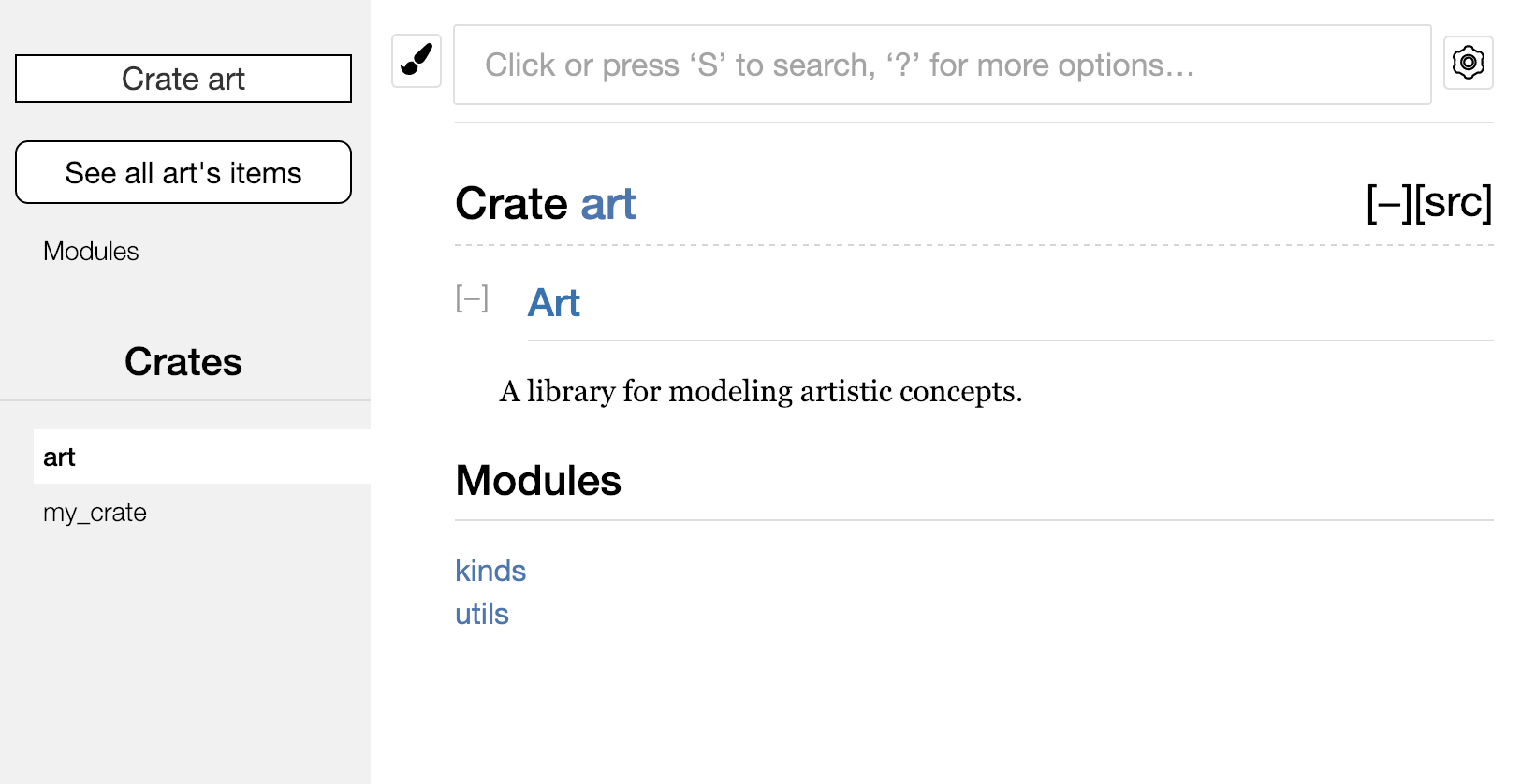

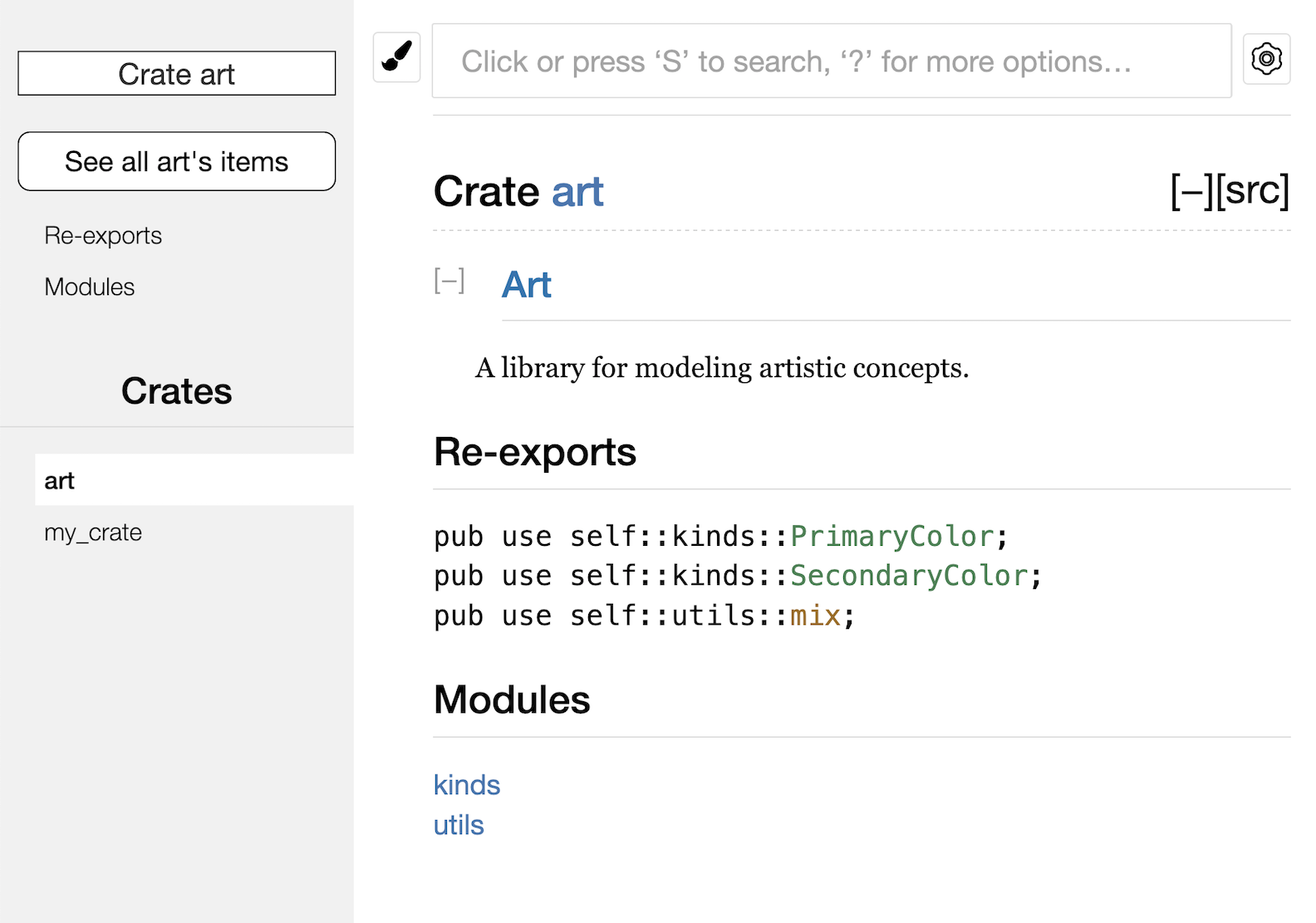

Too big!